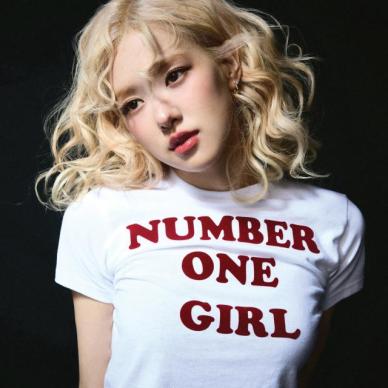

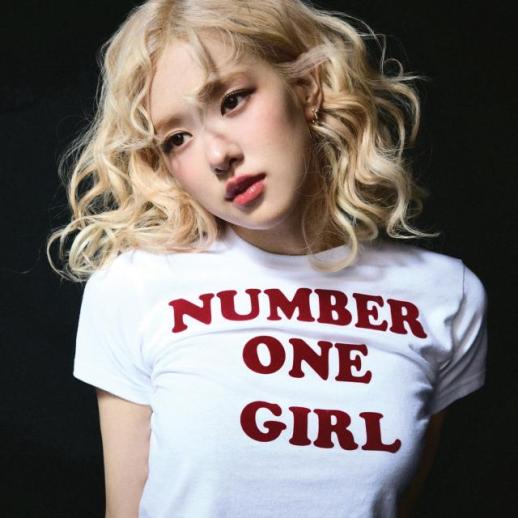

29日,韩国女性市民和大学生在首尔街头举行Deepfake谴责示威活动。【图片提供 韩联社】

近期,韩国爆出多起Deepfake(深度伪造技术)事件,该技术通过人工智能(AI)手段,将个人的声音、面部表情及身体动作合成虚假内容,并与源图片或视频进行叠加,使得虚假信息愈加逼真。此类恶性犯罪在韩国日趋猖獗,此前也多次曝出类似事件,使众多女性陷入不安和恐惧之中。然而调查显示,尽管事态严重,负责处理包括Deepfake事件在内的非法拍摄物等业务的数字性犯罪支援中心,其预算预计明年将进一步削减。

数字性犯罪支援中心的运维管理系统存在分散化和建设滞后问题,且人力资源短缺,因此多次强调增加预算的必要性,但却未得到相应的支持。女性家族部于30日透露,隶属于该部门的韩国女性人权振兴院所设立的数字性犯罪支援中心,明年的预算仅为32.62亿韩元(约合人民币1733.4万元),较今年(34.75亿韩元)减少6.3%。

数字性犯罪支援中心为了为了防止年轻女性的深度伪造色情内容泛滥,保护非法拍摄受害者,负责删除相关内容业务。通过追踪元数据“DNA”信息,对散布的影像进行监控,并要求网站运营者或托管公司删除相关视频。

女性人权振兴院发布的数据显示,从今年1月至8月25日为止,共删除502件深度伪造内容,同比(298件)增加68.4%。其中,涉及未成年受害者内容的件数多达238件,占比超过半数,较去年(86件)增加近3倍。

女性人权振兴院通过女性家族部向企划财政部申请将明年的预算增加至30亿韩元以上,旨在优化监控系统和填补人力。据悉,目前数字性犯罪支援系统存在明显的局限性,特别是“人脸搜索系统”技术水平较为落后,虽然具备识别受害者面部并进行匹配的能力,但经确认技术水平仍处于初级阶段。对此,数字性犯罪支援中心于今年6月公开删除业务流程,并强调:“尽管我们正在进行技术研发,但要实现技术优化,必须进一步增加预算支持。”

此外,数字性犯罪支援中心由于人力短缺造成在职员工业务负担过重,每名员工平均需要处理多达1.6万件非法内容。女性家族部相关人士表示:“网络上性犯罪仍然猖獗,政府应加大对数字性犯罪的打击力度,积极展开整治行动。采取包括增加人力、优化系统等在内的多种措施,彻底根除数字性犯罪问题。”